r/LocalLLaMA, 장기 에이전트 평가용 YC-Bench 결과를 집중 조명

Original: We gave 12 LLMs a startup to run for a year. GLM-5 nearly matched Claude Opus 4.6 at 11× lower cost. View original →

r/LocalLLaMA 게시물이 주목받은 이유는 흔한 리더보드 비교를 넘어, 장기적인 agent coherence를 정면으로 시험하는 평가를 소개했기 때문이다. 게시물은 YC-Bench 논문, 공개 리더보드, 그리고 코드 저장소를 함께 링크하면서, 짧은 QA나 코딩 태스크보다 훨씬 운영적인 시나리오를 강조했다. 커뮤니티 입장에서는 “에이전트가 실제로 얼마나 오래 일관되게 버티는가”를 보는 드문 자료였던 셈이다.

YC-Bench의 설정은 단순하지 않다. 에이전트는 수백 턴에 걸쳐 가상의 스타트업 CEO 역할을 수행하면서 직원 관리, 계약 선택, 급여 지급, 수익성 유지까지 처리해야 한다. 환경은 부분 관측이며, 일부 고객은 계약을 수락한 뒤 요구사항을 부풀리는 적대적 행태를 보인다. 논문 초록에 따르면 연구진은 12개 모델을 3개 시드로 평가했고, 시작 자본인 20만 달러를 일관되게 넘긴 모델은 세 개뿐이었다. 최고 성적은 Claude Opus 4.6의 평균 최종 자금 127만 달러였고, GLM-5는 약 11배 낮은 추론 비용으로 121만 달러에 도달했다.

더 흥미로운 부분은 실패 원인의 구조다. 논문은 context truncation 이후 정보를 유지하는 거의 유일한 수단인 scratchpad 사용이 성패를 가장 잘 예측했다고 설명한다. 반대로 파산의 주요 원인은 적대적 고객을 초기에 식별하지 못하는 것이었고, 전체 파산의 47%를 차지했다. 즉, 문제는 단순 추론 점수보다도 장기 기록, 전략 유지, 지연된 피드백을 버티는 운영 능력에 가까웠다. 이 점이 LocalLLaMA 사용자들에게는 특히 중요하다. 많은 agent demo가 한두 번의 멋진 성공 장면을 보여주지만, 실제 배포에서는 장기적인 일관성이 더 큰 비용 요인이기 때문이다.

이 Reddit 글이 의미 있는 이유는 frontier model 경쟁을 다른 축에서 보게 만든다는 데 있다. 더 큰 모델이 항상 더 안정적인 것은 아니고, 비용 대비 성능과 scratchpad 습관 같은 구현 세부가 결과를 크게 바꿀 수 있다는 메시지가 분명하다. 장기 에이전트 평가가 앞으로 중요해질수록, YC-Bench 같은 benchmark는 “무엇을 얼마나 오래 기억하고 전략을 유지할 수 있는가”를 따지는 기준점으로 계속 인용될 가능성이 높다.

Related Articles

Anthropic이 Claude Code의 주간 사용 한도를 7월 13일까지 한시적으로 50% 늘린다고 발표했다. 활발히 사용 중인 개발자들에게 즉각적인 혜택이 돌아간다.

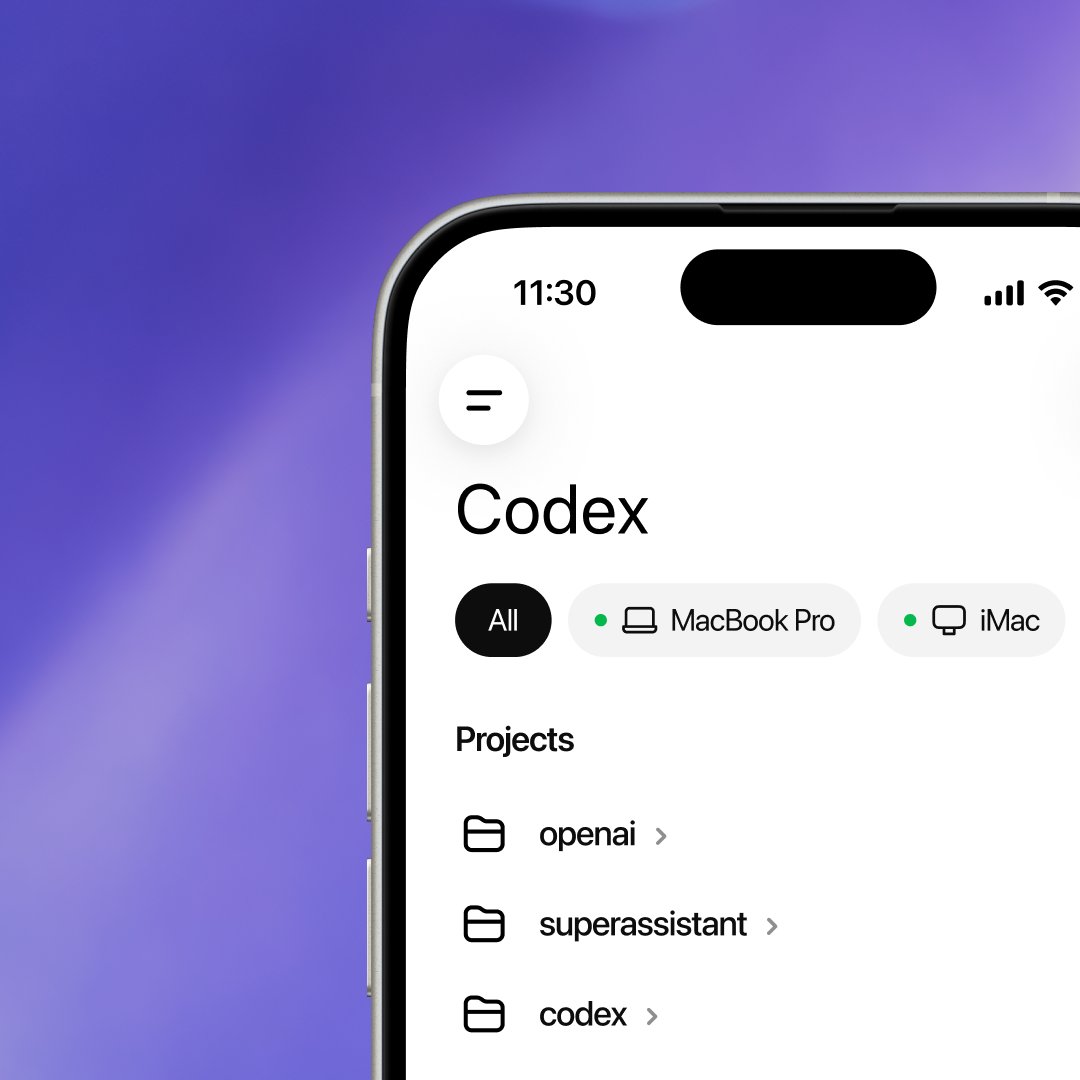

OpenAI가 AI 코딩 에이전트 Codex를 ChatGPT 모바일 앱에 도입한다고 발표했다. 스마트폰에서도 자연어로 코드 작성·수정·디버깅이 가능해진다.

MinishLab이 공개한 Semble은 AI 에이전트가 코드베이스를 탐색할 때 소모되는 토큰을 grep+read 방식 대비 98% 줄이는 오픈소스 코드 검색 라이브러리다. Claude Code, Cursor 등 주요 AI 코딩 플랫폼에서 MCP 서버로 즉시 활용 가능하며, NDCG@10 기준 변환기 모델의 99% 품질을 CPU만으로 달성했다.

Comments (0)

No comments yet. Be the first to comment!