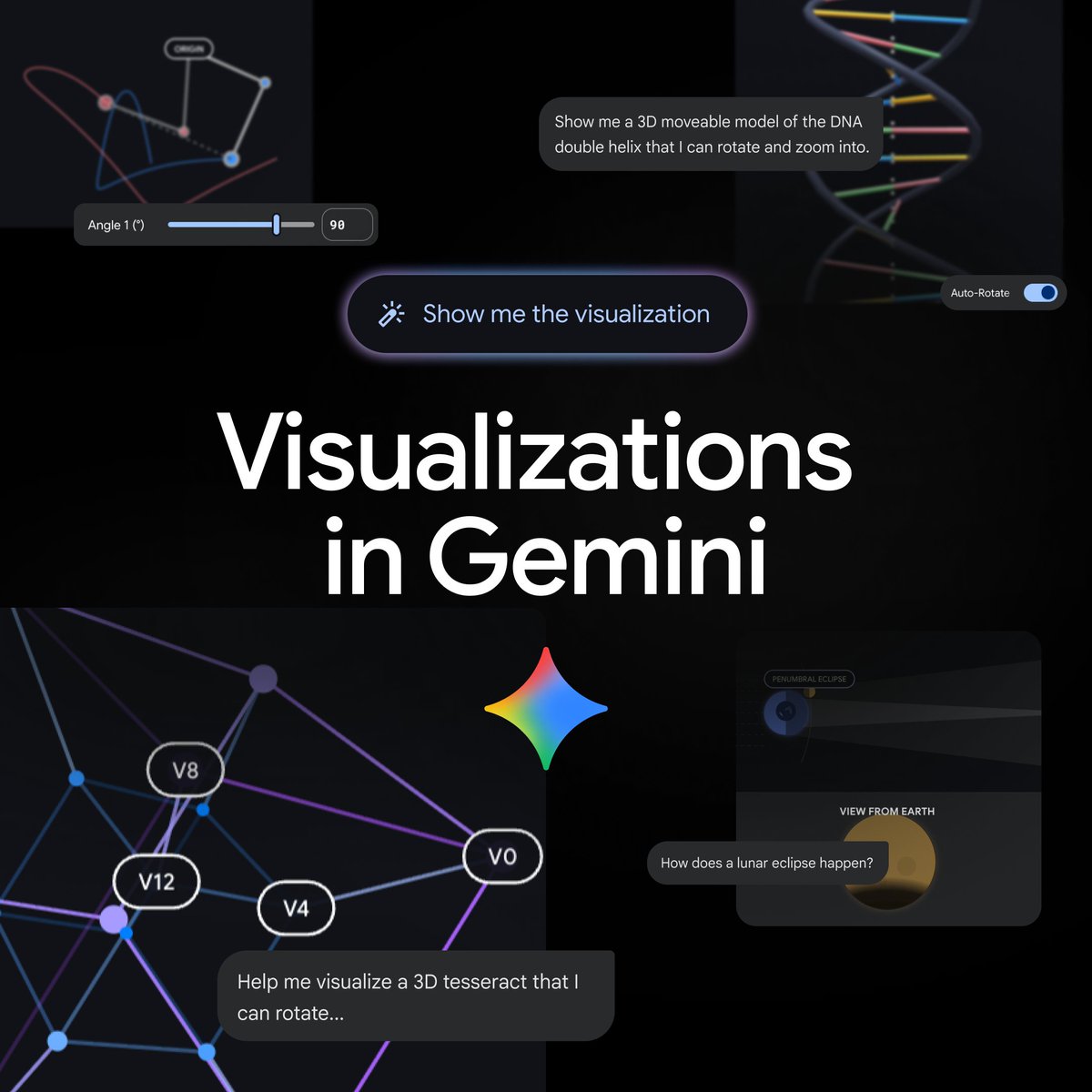

Gemini, chat 안에서 interactive visualization과 3D model 생성 지원

Original: Gemini can now transform your questions and complex concepts into customizable interactive visualizations directly in your chat. Adjust variables, rotate 3D models, and explore data for a more immersive way to learn and explore in Gemini. View original →

Gemini가 추가한 것

2026년 4월 9일, Gemini는 X에서 질문이나 복잡한 주제를 chat 안에서 customizable interactive visualization으로 바꿀 수 있다고 밝혔다. 함께 공개된 Google 제품 글에 따르면 이번 변화는 단순한 text 설명이나 static diagram을 넘는다. Gemini가 이제는 사용자가 직접 만질 수 있는 functional simulation을 생성할 수 있다는 뜻이다.

Google이 든 대표 예시는 orbital motion이다. 사용자는 고정된 그림만 보는 대신 gravity strength나 initial velocity 같은 값을 slider나 직접 입력으로 바꾸면서 궤도가 안정적으로 유지되는지 확인할 수 있다. Google은 또한 사용자가 molecule을 회전시키거나 다른 복잡한 system을 하나의 prompt로 탐색할 수 있다고 설명한다. 기능을 쓰려면 Gemini app에서 Pro model을 선택한 뒤, Gemini에게 개념을 “show me” 하거나 “help me visualize” 하라고 요청하면 된다.

왜 중요한가

이 업데이트는 Gemini app의 성격을 꽤 크게 바꾼다. 대부분의 assistant는 아직도 복잡한 개념을 prose, table, static image 중심으로 설명한다. 반면 interactive visualization은 답변을 사용자가 직접 실험해볼 수 있는 대상으로 바꾼다. 과학, 공학, 금융, 교육처럼 한 번에 변수 하나씩 바꾸며 반응을 보는 과정이 중요한 영역에서 특히 가치가 크다.

Google은 이 기능이 global Gemini app 사용자에게 순차 배포되지만, 아직 Education·Workspace account에는 제공되지 않는다고 밝혔다. 소스에 근거한 추론으로 보면, Google은 Gemini를 reasoning layer일 뿐 아니라 가벼운 simulation layer로도 밀고 있다. 이 방향이 자리 잡으면 Gemini는 text-first chatbot을 넘어, 질문을 던지고, model을 조작하고, 가정을 바꾸고, 결과를 바로 확인하는 학습 환경에 가까워질 수 있다.

출처: Gemini X 게시물 · Google 제품 글

Related Articles

Google은 2026년 4월 8일 Gemini에 notebooks를 도입해 chats와 source file을 NotebookLM과 동기화하는 공유 작업공간을 추가했다. 초기 배포는 web의 Google AI Ultra, Pro, Plus 구독자부터 시작되고, 이후 mobile, 추가 유럽 국가, free user로 확장될 예정이다.

Gemini는 2026년 4월 8일 past chats, files, custom instruction을 프로젝트 단위로 묶는 notebooks를 공개했다. Google은 notebooks가 NotebookLM과 동기화되며 우선 web의 Google AI Ultra·Pro·Plus 구독자에게 배포된다고 설명했다.

Google은 AI 경쟁의 축을 단순한 답변 품질에서 개인 data 문맥으로 옮기고 있다. Gemini Personal Intelligence의 인도 진출은 Gmail, Photos, YouTube 기록을 읽는 memory형 assistant를 거대한 시장에서 시험하겠다는 뜻에 가깝다.

Comments (0)

No comments yet. Be the first to comment!