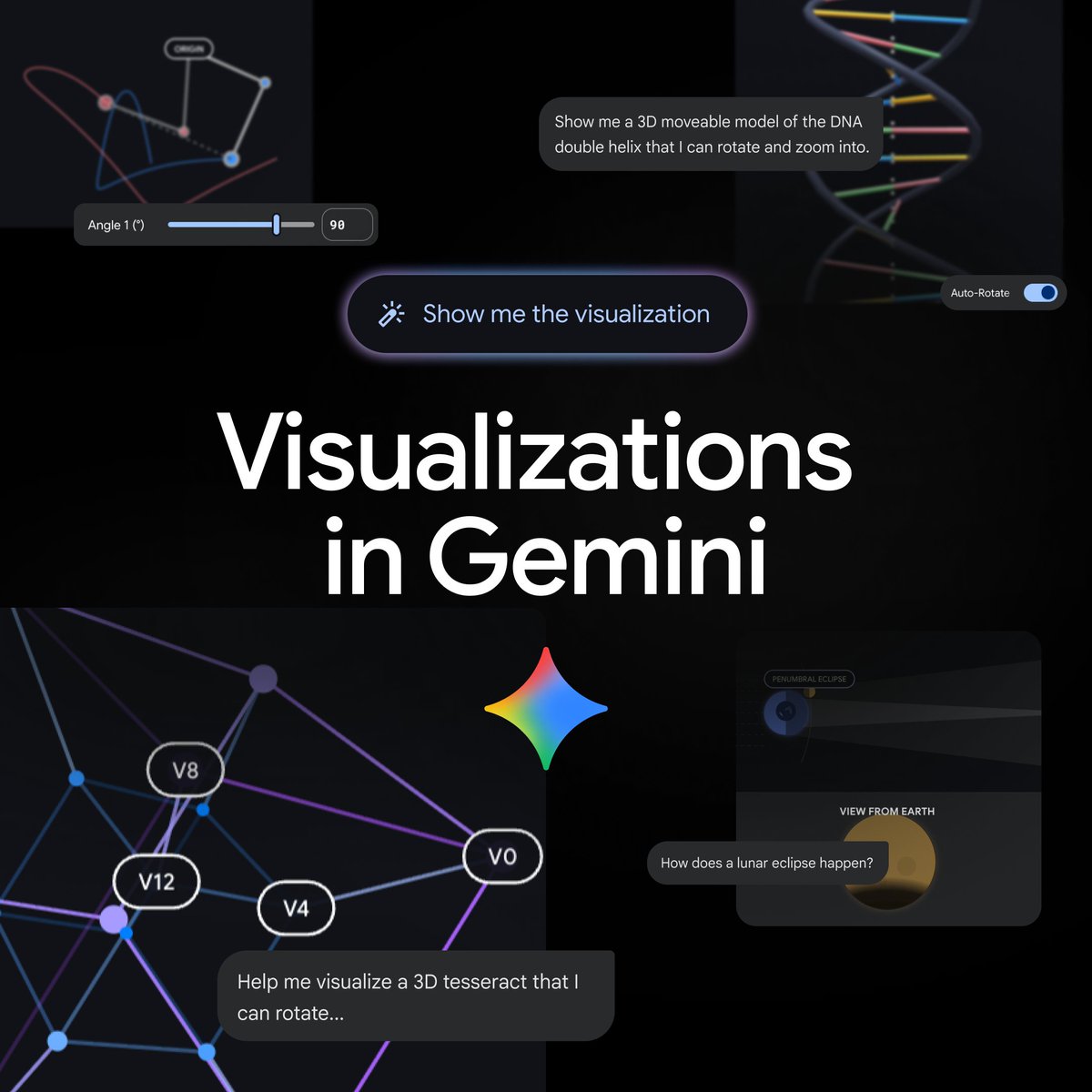

Gemini、chat内でinteractive visualizationと3D model生成に対応

Original: Gemini can now transform your questions and complex concepts into customizable interactive visualizations directly in your chat. Adjust variables, rotate 3D models, and explore data for a more immersive way to learn and explore in Gemini. View original →

Geminiが追加したもの

2026年4月9日、GeminiはXで、質問や複雑なtopicをchat内でcustomizable interactive visualizationに変換できるようになったと発表した。Googleのproduct postによれば、これはtext説明やstatic diagramの延長ではなく、ユーザーが直接触れられるfunctional simulationをGeminiが生成するという更新だ。

Googleが示した代表例はorbital motionだ。固定図を見るだけではなく、gravity strengthやinitial velocityの値をsliderや数値入力で調整し、その変化がorbitの安定性にどう影響するかをすぐ確認できる。Googleはさらに、moleculeを回転させたり、他の複雑なsystemを一つのpromptで探索したりできると説明している。利用するにはGemini appでPro modelを選び、「show me」や「help me visualize」といった形で概念を指定すればよい。

なぜ重要か

この更新はGemini appの性格をかなり変える。多くのassistantは今でも複雑な概念をprose、table、static imageで説明することが中心だ。interactive visualizationは、その回答をユーザーが自分で検証できる対象へ変える。科学、工学、金融、教育のように、変数を一つずつ動かして反応を見ること自体が理解の一部になる領域では特に相性がいい。

Googleによれば、この機能はglobalのGemini app利用者へ順次展開される一方、EducationとWorkspace accountではまだ利用できない。ソースからの推論として、GoogleはGeminiをreasoning layerであると同時に、軽量なsimulation layerとしても押し出そうとしているように見える。この方向が定着すれば、Geminiはtext-first chatbotを超え、質問し、modelを操作し、前提を変え、結果をその場で確かめるための学習環境に近づく。

Related Articles

Googleは2026年4月8日、Geminiにnotebooksを導入し、chatとsource fileをNotebookLMと同期する共通workspaceを追加した。初期展開はwebのGoogle AI Ultra、Pro、Plus購読者から始まり、今後mobile、追加の欧州地域、free userへ拡大される予定だ。

Geminiは2026年4月8日、past chatsやfiles、custom instructionをproject単位でまとめるnotebooksを発表した。Googleによれば、notebooksはNotebookLMと同期し、まずwebのGoogle AI Ultra・Pro・Plus利用者に展開される。

GoogleはMar 03, 2026、Gemini 3.1 Flash-LiteをGemini 3 seriesで最も高速かつcost-efficientなmodelとして発表した。preview段階から低価格と高throughputを前面に出し、大量developer workloadを狙う。

Comments (0)

No comments yet. Be the first to comment!