MacMindはHyperCardの中でtransformerを見える大きさにした

Original: Show HN: MacMind – A transformer neural network in HyperCard on a 1989 Macintosh View original →

MacMindがHNで注目されたのは、transformerを中身まで見える大きさにしたからだ。このprojectはAppleのHyperCardを支えたscripting languageであるHyperTalkだけで、1,216-parameter、single-layer、single-head transformerを実装している。作者はMacintosh SE/30でtrainingしたと説明しており、modelの各部分はHyperCardのscript editorで読める。

taskは意図的に小さい。Fast Fourier Transformの最初に使われるbit-reversal permutationを学ぶことだ。MacMindはformulaを教えられない。random examplesを受け取り、embeddings、positional encoding、scaled dot-product self-attention、cross-entropy loss、backpropagation、stochastic gradient descentを通じてpositional patternを学ぶ。repositoryにはpre-trained stack、training用のblank stack、mathを検証するPython/NumPy reference implementationも置かれている。

communityの熱は、この対比から来た。AIの話題はたいてい、より大きなclusters、より長いcontext windows、より高価なinferenceへ向かう。MacMindは逆方向へ行く。modern scaleが巨大でも、core training loop自体はmagicではないと示す。HNでは、old hardwareが概念を見える位置に押し出すという見方があった。1,216 parametersしかないなら、attention mapsやweight updatesはinfrastructureの裏に隠れた抽象ではなく、読める対象になる。

もちろん、MacMindはtiny LLMではない。language systemではなく、structured permutation problemのためのteaching demoだ。価値は、動くtransformerを手元で触れる距離に置くことにある。HyperCardでprogrammingを覚えた人には、1987年のscripting environmentが今日のmodel boomの基本機構を載せているというnostalgiaもある。

AI literacyにも効く。vintage Macで開き、変更し、保存し、もう一度開いてinspectできるなら、“attention”はbranding wordではなくoperationsの集まりになる。HNがこのprojectを単なるretro stunt以上として見た理由はそこにある。

Sources: HN discussion, MacMind repository.

Related Articles

Hacker NewsのShow HNで注目されたGuppyLMは、60Kのsynthetic conversationsと意図的に単純化したtransformer構成でLLM学習の全体像を見せる。Colabとブラウザの両方で試せる教育向けの超小型モデルだ。

Stanfordの公開 CS25講義は、Zoom、recordings、Discordを通じて campus外まで広がる Transformer研究の学習チャネルとして再び機能している。

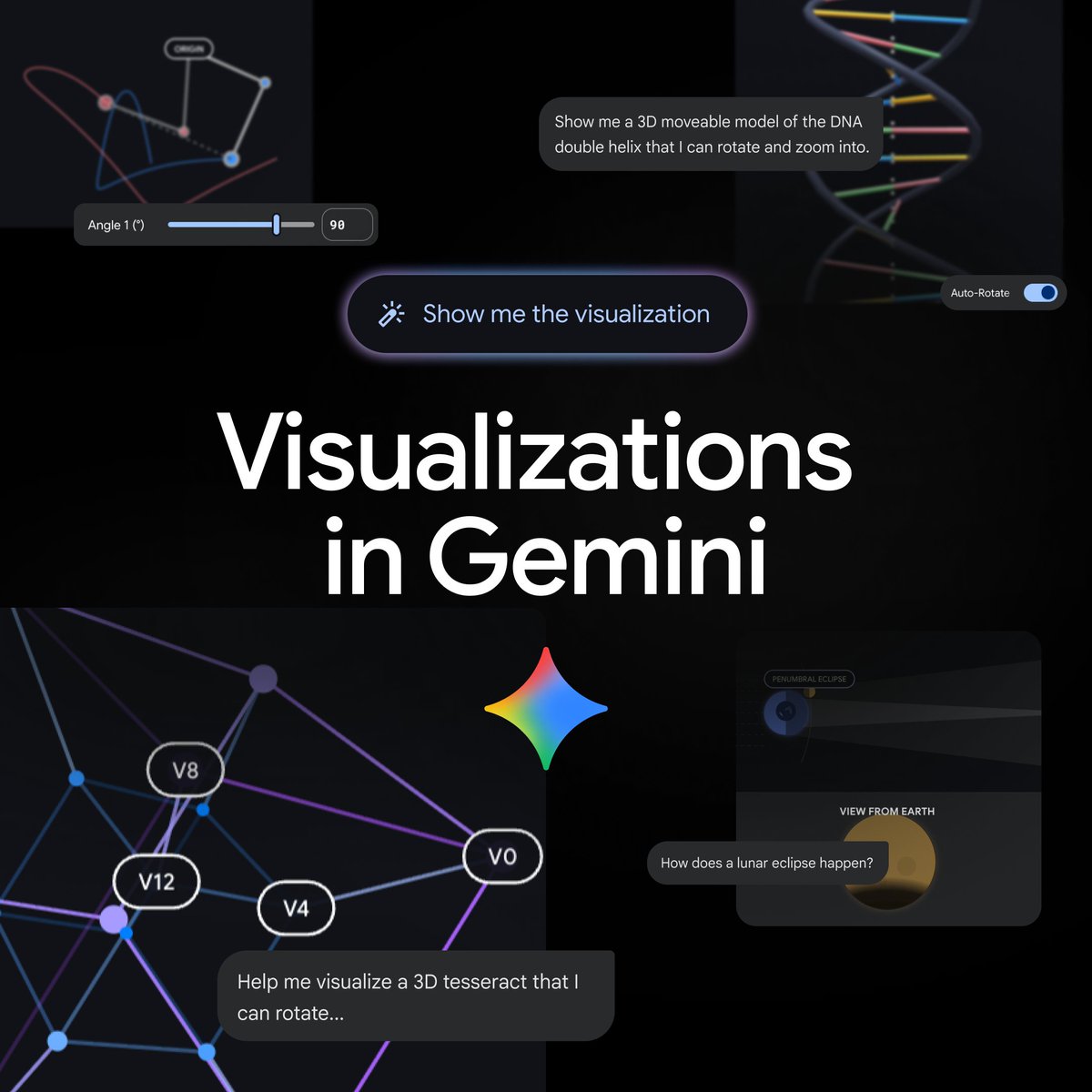

Geminiは2026年4月9日、complex conceptをchat内でinteractive visualizationに変換できるようになったと発表した。Googleのproduct postによれば、globalのGemini app利用者向けにfunctional simulationとparameter調整機能が加わる。

Comments (0)

No comments yet. Be the first to comment!