MacMind, HyperCard 안에서 transformer를 손에 잡히게 만들었다

Original: Show HN: MacMind – A transformer neural network in HyperCard on a 1989 Macintosh View original →

MacMind가 HN에서 주목받은 이유는 transformer를 직접 들여다볼 수 있을 만큼 작게 만들었기 때문이다. 이 project는 Apple HyperCard의 scripting language인 HyperTalk만으로 1,216-parameter, single-layer, single-head transformer를 구현한다. 작성자는 Macintosh SE/30에서 훈련했다고 설명하며, model의 모든 부분을 HyperCard script editor 안에서 읽을 수 있다고 적었다.

task는 의도적으로 좁다. Fast Fourier Transform의 시작 단계에서 쓰이는 bit-reversal permutation을 배우는 것이다. MacMind는 formula를 받지 않는다. random example을 보고 embeddings, positional encoding, scaled dot-product self-attention, cross-entropy loss, backpropagation, stochastic gradient descent를 통해 positional pattern을 학습한다. repository에는 pre-trained stack, 직접 training할 수 있는 blank stack, math를 검증하는 Python/NumPy reference implementation도 있다.

community의 에너지는 대비에서 나왔다. AI 논의 대부분은 더 큰 cluster, 더 긴 context window, 더 비싼 inference로 흘러간다. MacMind는 반대 방향으로 간다. modern scale이 거대하더라도 core training loop 자체는 magic이 아니라는 점을 보여준다. HN의 한 흐름은 old hardware가 개념을 눈앞에 놓는다는 것이었다. parameter가 1,216개뿐이면 attention map과 weight update가 infrastructure 뒤에 숨은 추상이 아니라 읽을 수 있는 대상이 된다.

그렇다고 MacMind가 tiny LLM이라는 뜻은 아니다. 이것은 language system이 아니라 structured permutation problem을 위한 teaching demo다. 가치는 작동하는 transformer를 가까이서 만질 수 있게 만드는 데 있다. HyperCard로 programming을 배운 사람들에게는 1987년 scripting environment가 오늘의 model boom을 이루는 기본 장치를 품는다는 nostalgia도 있다.

AI literacy 측면에서도 유용하다. vintage Mac에서 열고, 고치고, 저장하고, 다시 열어 inspect할 수 있다면 “attention”은 branding word가 아니라 operation들의 묶음이 된다. HN이 이 project를 단순한 retro stunt 이상으로 본 이유가 여기에 있다.

Sources: HN discussion, MacMind repository.

Related Articles

Hacker News의 Show HN에서 주목받은 GuppyLM은 60K 합성 대화 데이터와 단순한 transformer 구조로 LLM 학습 전 과정을 드러낸다. Colab과 브라우저에서 바로 실행할 수 있는 교육용 초소형 모델이라는 점이 핵심이다.

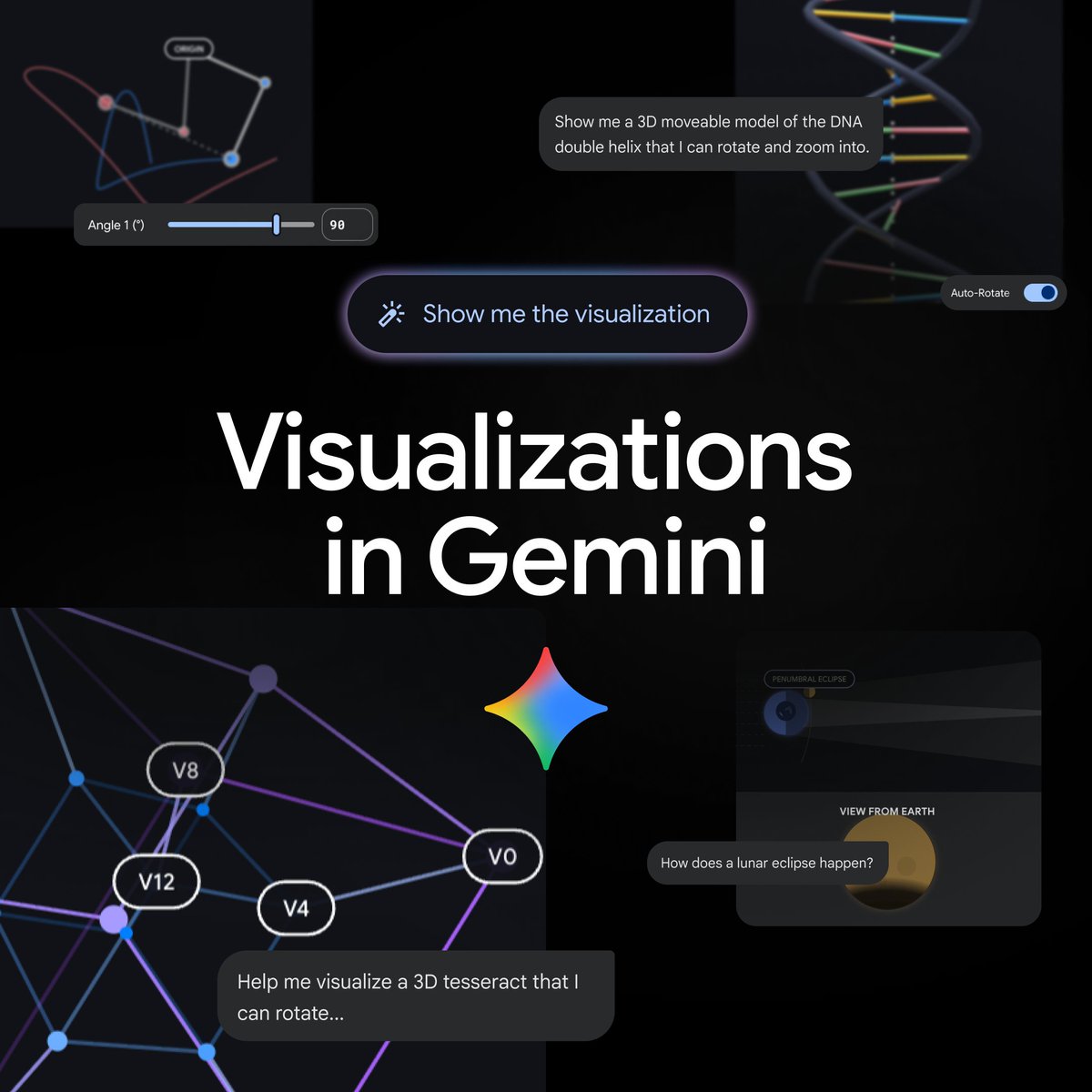

Gemini는 2026년 4월 9일 complex concept를 chat 안에서 interactive visualization으로 바꿀 수 있다고 밝혔다. Google 제품 글에 따르면 이번 업데이트는 global Gemini app 사용자에게 functional simulation과 parameter 조정 기능을 제공한다.

Stanford의 공개 CS25 강의는 Zoom, recordings, Discord를 통해 campus 밖까지 확장된 Transformer 연구 학습 채널로 다시 작동하고 있다.

Comments (0)

No comments yet. Be the first to comment!