NVIDIA Lyra 2.0、1枚の画像からIsaac Sim向け探索可能3D世界を大規模生成可能に

Original: Today, we released Lyra 2.0, a framework for generating persistent, explorable 3D worlds at scale, from NVIDIA Research. Generating large-scale, complex environments is difficult for AI models. Current models often “forget” what spaces look like and lose track of movement over time, causing objects to shift, blur, or appear inconsistent. This prevents them from creating the reliable 3D environments required for downstream simulations. Lyra 2.0 solves these issues by: ✅ Maintaining per-frame 3D geometry to retrieve past frames and establish spatial correspondences ✅ Using self-augmented training to correct its own temporal drifting. Lyra 2.0 turns an image into a 3D world you can walk through, look back, and drop a robot into for real-time rendering, simulation, and immersive applications. ➡️ Learn more: https://research.nvidia.com/labs/sil/projects/lyra2/ 📄 Read the paper: https://arxiv.org/abs/2604.13036 View original →

この投稿が示したこと

NVIDIA AI Developerは “Lyra 2.0” を、“persistent, explorable 3D worlds at scale” を生成する framework と説明した。投稿は、現在のAIモデルが空間の見た目を忘れたり動きを追跡できなかったりするため、object がずれたりぼやけたりすると指摘している。Lyra 2.0の対策は、過去frameを取り戻し spatial correspondence を作る per-frame 3D geometry と、temporal drifting を直す self-augmented training だ。

このアカウントはNVIDIAの開発者向けAIチャネルで、research code、model demo、applied AI workflow をよく流す。今回の投稿も単なる映像デモではない。リンク先は research page と paper で、プロジェクトページは Lyra 2.0 を camera-controlled walkthrough video を生成し、それを feed-forward reconstruction で3Dへ持ち上げる方法として説明している。

技術ディテールの意味

中心課題は consistency だ。Text-to-video や image-to-video system は短い動きならもっともらしく作れるが、長い scene exploration では camera が回り、戻り、同じ場所を再訪したときに geometry を覚えている必要がある。NVIDIAは Lyra 2.0 が generated frame 間の information routing で spatial forgetting を抑え、self-augmented training で temporal drift を直すとしている。プロジェクトページでは出力を 3D Gaussian splats と mesh に変換する例も示されている。

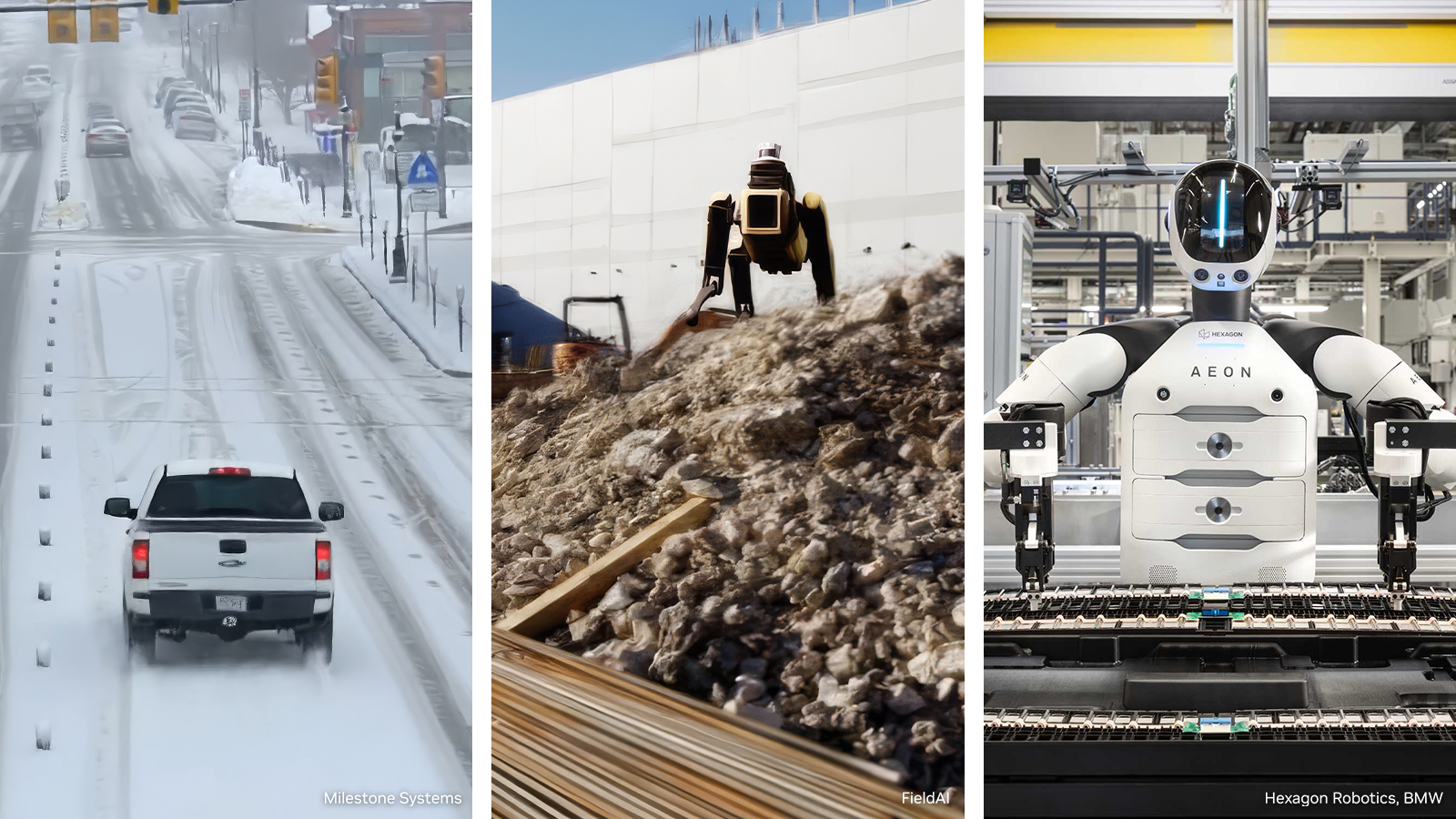

最も高シグナルなのは robotics との接続だ。NVIDIAは生成した scene を physics engine に export でき、NVIDIA Isaac Sim で robot navigation と interaction に使う例を示した。これは image-based world generation が embodied AI simulation に入る可能性を示す。そこでは、出力は美しい walkthrough だけでなく、agent が移動し、知覚し、policy を試せるだけの空間的一貫性を持たなければならない。

次に見るべきなのは、NVIDIAが長い camera path で consistency を stress-test できるだけの code と evaluation detail を出すか、そして Isaac Sim ユーザーが Lyra の scene を実用的な synthetic training environment に変えられるかだ。出典: NVIDIA AI Developer X投稿 · Lyra 2.0 project page · arXiv paper

Related Articles

NVIDIAは2026年3月16日、robotics、vision AI agents、autonomous vehicles 向けの training data 生成・増強・評価を行う open reference architecture を発表した。Microsoft Azure と Nebius が統合を進めており、NVIDIAは4月の GitHub 公開を予告している。

宇宙data centerはまだ未来の言葉に近いが、宇宙inferenceはもう事業の形を取り始めている。Keplerのclusterは10基の衛星にNvidia Orin 40基を載せ、顧客18社を得て、space computeをpitch deckの外へ引き出した。

r/MachineLearningの投稿とリンク先のbenchmark記事は、RTX 5090のbatched FP32 SGEMMが非効率なcuBLAS経路に入り、GPU計算資源を大きく余らせていると主張する。

Comments (0)

No comments yet. Be the first to comment!