NVIDIA、robotics・autonomous systems 向け Physical AI Data Factory Blueprint を公開

Original: NVIDIA Announces Open Physical AI Data Factory Blueprint to Accelerate Robotics, Vision AI Agents and Autonomous Vehicle Development View original →

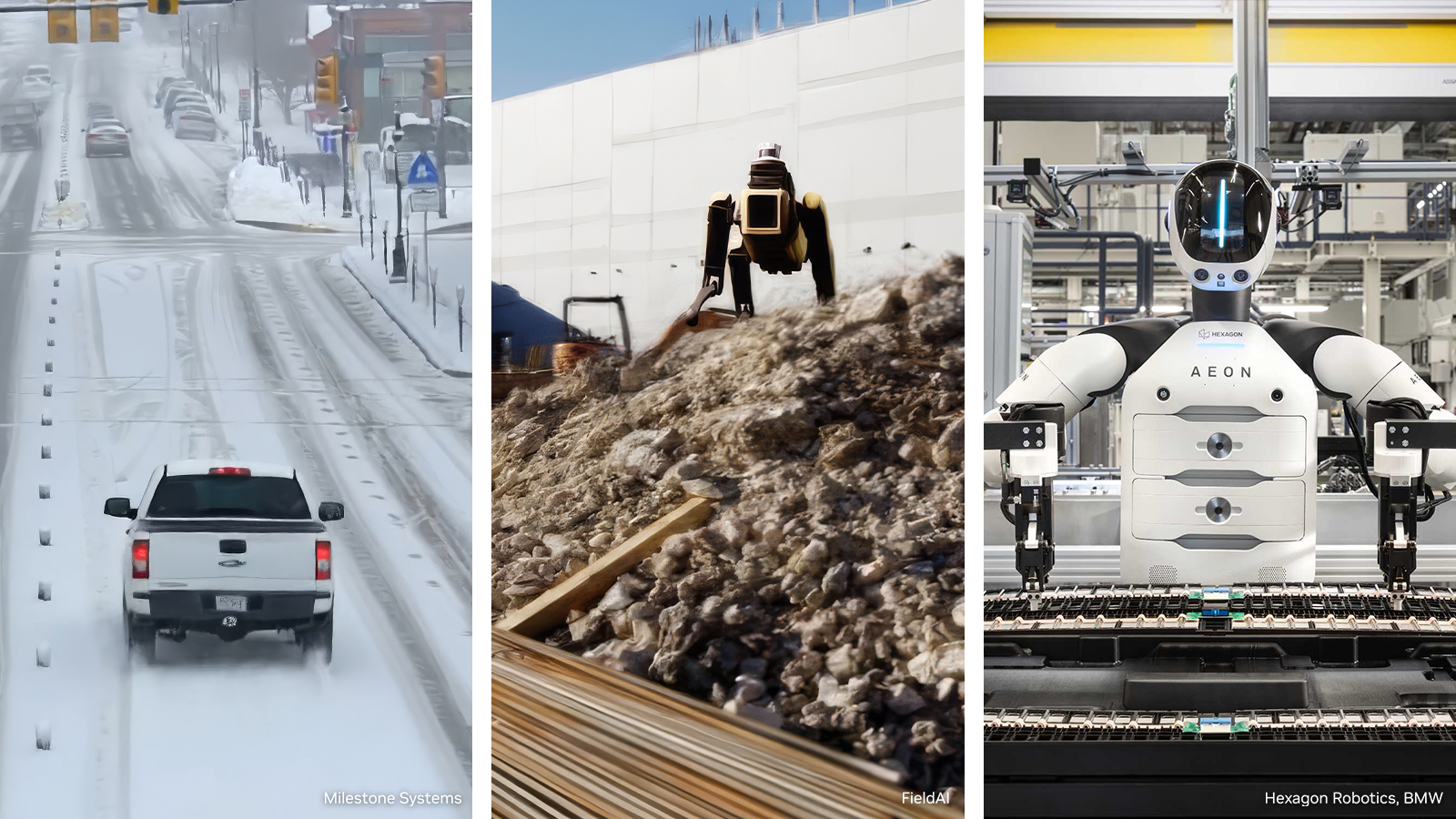

NVIDIAの2026年3月16日のGTC発表は、physical AI における最大級の課題である training data 不足を正面から狙ったものだ。今回発表された Physical AI Data Factory Blueprint は、robotics、vision AI agents、autonomous vehicles 向けに data generation、augmentation、evaluation を自動化する open reference architecture である。

中核となる考え方は、限られた real-world data を、はるかに大きく多様な training set に変換することだ。NVIDIAは Cosmos world foundation models と coding agents を使い、実際には取得コストが高い rare edge cases や long-tail scenarios を大量に生成できると説明した。workflow は、dataset の処理と annotation を担う Cosmos Curator、data を拡張して多様化する Cosmos Transfer、そして Cosmos Reason を用いて生成結果を自動で採点・選別する Cosmos Evaluator に分かれている。

NVIDIAはすでにこの blueprint を使って、long-tail autonomous driving 向けの open reasoning-based vision language action models である Alpamayo を train・evaluate しているという。さらに Skild AI は general-purpose robot foundation models に適用し、Uber は autonomous vehicle development に利用しているとした。つまり今回の発表は単なる tooling の追加ではなく、embodied AI 向け標準 data pipeline の主導権を取りに行く動きと言える。

もう一つの注目点は orchestration だ。NVIDIAによれば、open source の OSMO framework は Claude Code、OpenAI Codex、Cursor と統合され、coding agents が複雑な compute environment の resource 管理や bottleneck 解消、model delivery の高速化を担えるようになった。インフラ面では Microsoft Azure が Azure IoT Operations、Microsoft Fabric、Real-Time Intelligence、Microsoft Foundry と結び付く open physical AI toolchain に統合中で、Nebius も RTX PRO 6000 Blackwell Server Edition GPUs、storage、labeling、managed inference を備えた AI Cloud に OSMO を組み込んでいる。

4月に GitHub 公開が実現すれば、NVIDIAは compute supplier であるだけでなく、physical AI workflow の運用レイヤーにも影響力を広げることになる。開発側にとっての実際の論点は、標準 blueprint が robotics と autonomous systems における production-grade dataset 構築の時間とコストをどこまで削減できるかだ。

なぜ重要か

- robotics と autonomous vehicles の開発を遅らせる data bottleneck を直接狙っている。

- world models、evaluation tools、coding agents を一つの再利用可能な workflow にまとめた。

- NVIDIAの影響力を chips や cloud infrastructure から physical AI pipeline の運用層へ広げる動きだ。

Related Articles

重要なのは、NVIDIAが生成動画研究を短いclipではなく simulation-ready な3D environmentへ向けている点だ。投稿は Lyra 2.0 が per-frame 3D geometry と self-augmented training を使うと説明し、プロジェクトページは Gaussian splats と mesh を Isaac Sim に出せることを示している。

今回の要点は新しい提携そのものではない。NVIDIAとGoogle CloudはA5X Rubin基盤を単一サイト8万基、マルチサイトで96万基まで拡張でき、推論コストと電力当たり処理量を前世代比で最大10倍改善できると示した。

NVIDIAはHugging FaceでNemotron-Personas-Koreaを公開した。韓国の公的統計に基づく7 million synthetic personasは、agent localizationが翻訳だけでなく地域、敬語、職業、公共サービス文脈まで含むことを示す。

Comments (0)

No comments yet. Be the first to comment!