Google DeepMind는 로봇용 embodied reasoning을 데모 수준에서 실제 작업 쪽으로 더 밀어 넣고 있다. 연결된 스레드와 블로그에 따르면 Gemini Robotics-ER 1.6은 agentic vision 사용 시 계기판 판독 성공률 93%를 기록했고, 영상 기반 injury risk 감지는 Gemini 3.0 Flash 대비 10% 개선됐다.

#robotics

RSS Feedr/singularity의 관심은 화려한 영상보다 21km 동안 드러나는 약점에 있다. Euronews 보도에 따르면 4월 19일 본 레이스를 앞두고 베이징 E-Town에서 70개 넘는 팀이 overnight test run에 참여했고, 약 40%의 팀이 fully autonomous navigation에 도전하고 있다.

Generalist는 GEN-1이 더 높은 success rate, 빠른 execution, 낮은 task-specific robot data 요구량을 통해 단순 physical task의 commercial threshold를 넘기 시작했다고 말한다.

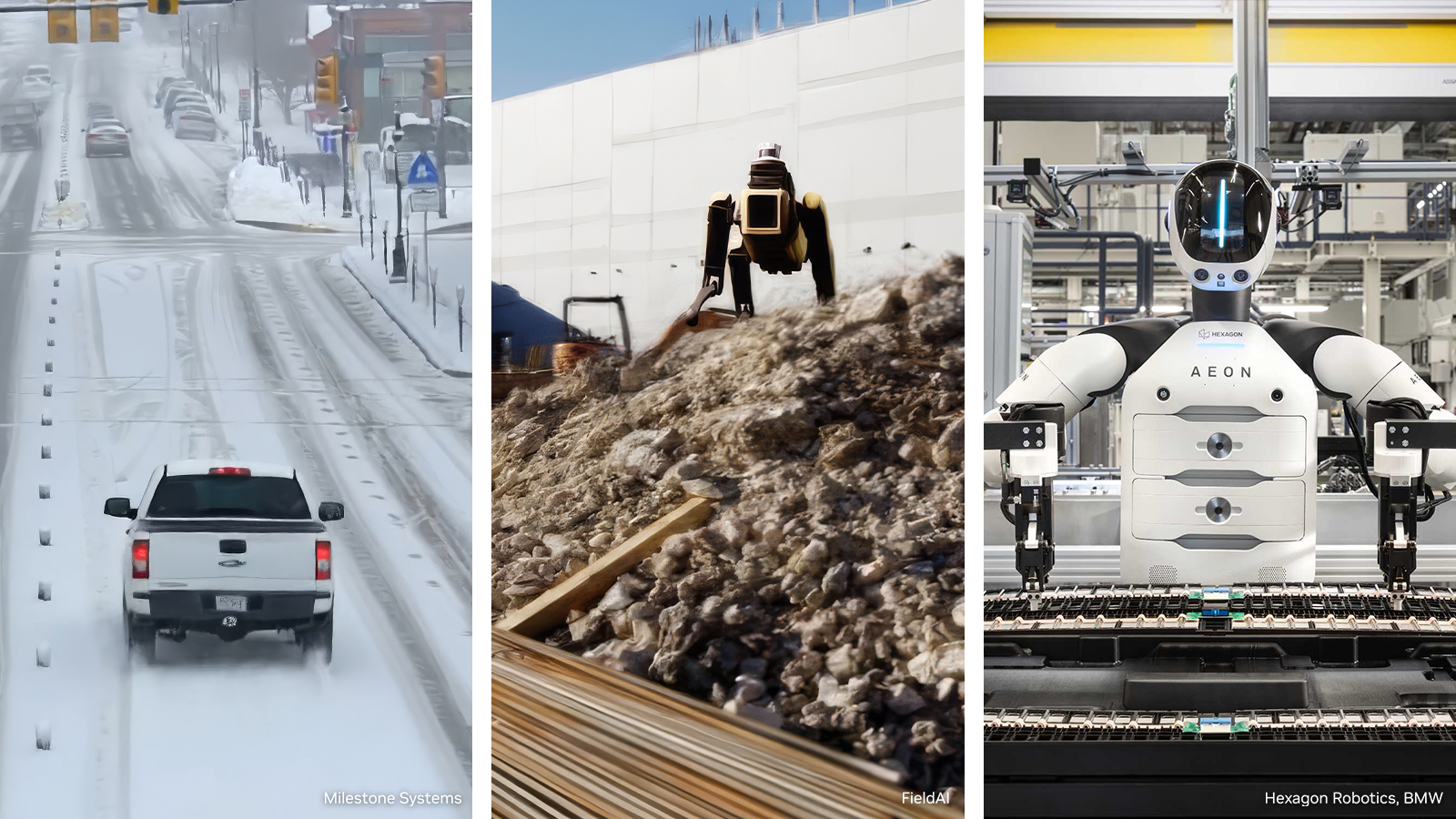

NVIDIA는 2026년 3월 16일 robotics, vision AI agent, autonomous vehicle 개발을 겨냥한 Open Physical AI Data Factory Blueprint를 공개했다. 핵심은 scarce real-world data를 synthetic data와 automated evaluation으로 확장해 physical AI 개발 속도를 높이겠다는 것이다.

Google DeepMind와 Agile Robots는 2026년 3월 24일 Gemini Robotics foundation models와 Agile Robots hardware를 결합해 industrial environment용 reasoning robot을 개발하겠다고 밝혔다. 초기 초점은 reliability와 scale이 중요한 manufacturing 등 고가치 automation use case다.

Google DeepMind는 2026년 1월 22일 D4RT를 공개하며 dynamic 4D scene reconstruction and tracking을 하나의 AI model로 통합했다. 회사는 이 모델이 기존 방법 대비 18배에서 300배 빠르고 robotics와 AR 같은 real-time use case에 적합하다고 설명했다.

NVIDIA는 2026년 3월 12일 TensorRT Edge-LLM이 Jetson과 DRIVE에서 MoE, Nemotron 2 Nano, Qwen3-TTS/ASR, Cosmos Reason 2를 지원한다고 밝혔다. 회사는 이를 robotics와 autonomous vehicle용 low-latency edge reasoning runtime으로 포지셔닝하고 있다.

Hugging Face는 2026년 3월 9일 LeRobot v0.5.0을 공개하며 첫 humanoid인 Unitree G1 지원, 새로운 robot learning policy, 더 빠른 dataset pipeline을 발표했다. 이번 릴리스는 Python 3.12+, Transformers v5, EnvHub, NVIDIA IsaacLab-Arena 통합까지 포함한다.

NVIDIA는 2026년 3월 20일 Cosmos world foundation model 계열이 Transfer 2.5, Predict 2.5, Reason 2로 다시 진화했다고 밝혔다. 연결된 NVIDIA Technical Blog는 이번 업데이트를 고품질 synthetic data 생성, long-tail scenario 보강, 로봇·자율주행용 physical reasoning 강화로 설명한다.

2026년 3월 16일 Popular Science 기사를 공유한 r/artificial 게시물은 590 points와 62 comments를 기록했다. 기사에 따르면 Niantic Spatial은 300억 장이 넘는 Pokémon Go 이미지를 기반으로 Visual Positioning System을 학습했고, 이제 Coco Robotics와 협력해 GPS가 불안정한 거리에서도 delivery robot가 centimeter-level precision으로 위치를 잡게 하려 한다.

2026년 3월 15일 r/singularity의 LATENT 글은 3,150 points와 376 comments를 기록했다. 이 연구는 경기 전체 motion capture 대신 5시간 분량의 human motion fragment로 humanoid tennis policy를 학습하는 접근을 제시한다.

NVIDIA는 2026년 3월 16일 robotics, vision AI agents, autonomous vehicles를 위한 training data 생성·증강·평가용 open reference architecture를 발표했다. Microsoft Azure와 Nebius가 이 blueprint를 통합 중이며, NVIDIA는 4월 GitHub 공개를 예고했다.